|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

대형언어모델(LLM)의 성능을 끌어올리기 위해 단순한 알고리즘 개선을 넘어 모델 구조 자체를 근본적으로 재설계하려는 시도가 본격화하고 있다.

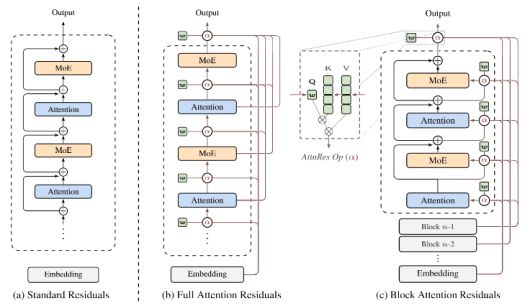

문샷 AI 연구진은 15일(현지시간) 기존 트랜스포머 구조의 핵심 요소였던 잔차 연결(Residual connection)을 대체하는 새로운 방식인 '주의 잔차(AttnRes·Attention Residuals)'를 공개했다.

잔차 연결은 신경망의 층이 깊어질수록 앞부분에서 만들어진 핵심 정보가 점점 약해지고, 학습 신호인 기울기가 사라지면서 오히려 성능이 떨어지는 문제를 해결하기 위해 고안된 연결 방식이다. 핵심 아이디어는 각 층에서 새로 계산한 결과에 그 층의 입력값을 그대로 더해 다음 층으로 전달하는 것이다. 신경망 안에 원래 정보를 그대로 전달하는 지름길을 하나 추가하는 구조라고 볼 수 있다.

기존 트랜스포머 모델은 각 레이어의 출력을 단순히 누적하는 잔차 연결 방식을 사용해 왔다. 이 구조는 깊은 신경망에서도 안정적인 학습을 가능하게 했지만, 시간이 지날수록 구조적 한계도 드러났다. 모든 이전 레이어의 정보가 동일한 비중으로 합쳐지면서, 특정 정보의 중요도가 희석되고 은닉 상태(hidden state)의 크기가 계속 증가하는 문제가 발생한 것이다.

이로 인해 초기 레이어의 정보는 점점 묻히고, 후반 레이어는 영향력을 확보하기 위해 더 큰 출력을 만들어야 하는 비효율적인 구조가 형성됐다. 결과적으로 모델의 깊이가 깊어질수록 정보 활용 효율이 떨어지고 학습 안정성에도 부담이 생겼다.

주의 잔차는 이러한 문제를 해결하기 위해 네트워크의 '깊이 방향'에도 어텐션 메커니즘을 적용한 것이 핵심이다. 기존처럼 모든 과거 정보를 동일하게 더하는 대신, 각 레이어가 필요한 정보만 선택적으로 가져오도록 설계됐다.

즉 현재 레이어는 이전 레이어들의 출력 중에서 중요한 정보에 더 높은 가중치를 부여하고, 불필요한 정보는 억제하는 방식으로 작동한다. 이는 과거 순환신경망(RNN)이 가진 한계를 어텐션으로 극복했던 것과 유사한 접근으로, 신경망 내부 정보 흐름을 정교하게 제어할 수 있게 한다.

다만 모든 이전 레이어를 대상으로 어텐션을 적용하는 방식은 연산량과 메모리 사용량이 급격히 증가하는 문제가 있다. 이를 해결하기 위해 연구진은 블록 주의 잔차(Block AttnRes)라는 구조를 함께 도입했다.

이 방식은 레이어를 여러 블록으로 나누고, 각 블록의 정보를 하나의 대표값으로 압축한 뒤 블록 단위로만 어텐션을 수행한다. 이를 통해 메모리와 통신 비용을 크게 줄이면서도 성능 개선 효과를 유지할 수 있다. 실제로 파이프라인 병렬 환경에서도 학습 오버헤드는 4% 미만, 추론 지연은 2% 이하로 억제된 것으로 나타났다.

실험 결과도 인상적이다. 480억개의 총 매개변수와 30억개의 활성 매개변수를 가진 전문가 혼합(MoE) 아키텍처인 키미 리니어(Kimi Linear)에 주의 잔차를 적용한 결과, 기존 대비 연산 효율은 1.25배 향상되면서도 추론 지연 증가는 거의 없었다. 이는 동일한 성능을 얻기 위해 필요한 연산 자원을 크게 줄일 수 있음을 의미한다.

|

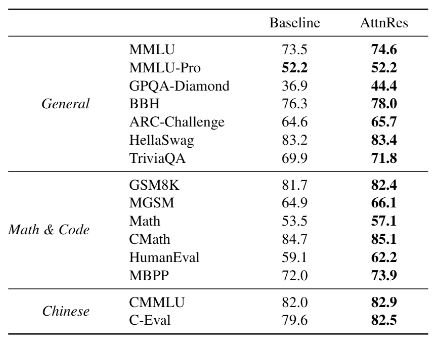

다양한 벤치마크에서 성능 향상이 확인됐다. 'MMLU'에서는 73.5에서 74.6으로, 'GPQA-다이아몬드'에서는 36.9에서 44.4로, 'BBH'에서는 76.3에서 78.0으로, '매스(Math)'에서는 53.5에서 57.1로, '휴먼에밸(HumanEval)'에서는 59.1에서 62.2로, 'MBPP'에서는 72.0에서 73.9로, 'CMMLU'에서는 82.0에서 82.9로, 'C-Eval'에서는 79.6에서 82.5로 성능이 향상된 것으로 보고됐다.

특히 복잡한 추론이 필요한 수학, 코드 생성, 과학 문제 해결 영역에서 뚜렷한 개선을 보이며, 다단계 추론 능력이 중요한 차세대 AI 모델에 적합한 구조로 평가된다.

박찬 기자 cpark@aitimes.com

<저작권자 Copyright ⓒ AI타임스 무단전재 및 재배포 금지>

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.