[인텔 이노베이션 2023] "글로벌 15개 슈퍼 컴퓨터에 이름 올리겠다"

|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

[디지털데일리 김문기 기자] 인텔이 AI 시장을 위한 가속기 개발에 힘을 모으고 있다.

팻 겔싱어 인텔 CEO는 20일(현지시간) 미국 캘리포니아주 새너제이(San Jose)에서 열린 연례 개발자 행사 인텔 이노베이션 2023에 기조연설자로 나서 AI 가속기 시장을 주도할 계획이며, 그에 따른 실 사례를 공개했다.

이 자리에서 인텔은 최근 공개된 MLPerf AI 추론 성능 결과는 가장 크고 어려운 생성형 AI 및 대규모 언어 모델(LLM)을 포함한 AI 기술의 모든 단계를 지원하기 위한 인텔의 노력을 입증했다. 더불어, 인텔 가우디2 가속기가 AI 컴퓨팅 요구사항을 충족할 수 있는 유일한 대안이라는 점을 부각했다.

또한 겔싱어 CEO는 인텔 제온 프로세서와 4천개의 인텔 가우디2 하드웨어 가속기 기반으로 스태빌리티AI(StabilityAI)를 위해 구축한 대규모 AI 슈퍼컴퓨터를 공개하기도 했다. 스태빌리티AI는 영국의 인공지능(AI) 기업으로 생성형 AI 모델 분야를 주도하고 있다. 지난해말 10억 달러의 기업가치를 인정받기도 했다.

그는 “우리는 세계 최고의 15개 AI 슈퍼컴퓨터 중 하나가 될 수 있도록 하기 위해 그들과 함께 협력을 진행하고 있다”고 소개했다.

인텔 ‘가우디2’는 딥러닝 가속기다. 인텔에 따르면 딥러닝 학습 및 추론에서 엔비디아 A100 대비 최대 2.4배 더 빠른 성능을 제공한다는 설명이다.

또한 올해 출시된 4세대 제온 스케일러블 프로세서(코드명 사파이어 래피즈)의 AI 가속기에 대해서도 강조했다. 영상을 통해 등장한 징런 저우 알리바바 클라우드 최고기술책임자(CTO)는 ‘생성형 AI 및 LLM인 알리바바 클라우드의 통이 파운데이션 모델(Tongyi Foundation Model)’에 AI 가속기를 탑재한 4세대 인텔 제온 프로세서 적용 사례를 소개했다. 그는 인텔 기술을 통해 “평균 3배 빠른1 응답 시간을 달성했다”고 밝혔다.

앞서 4세대 인텔 제온 스케일러블 프로세서는 일본 교토대학교, 이탈리아 시네카, 미국 로체스터 대학교 등에도 도입된 바 있다.

|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

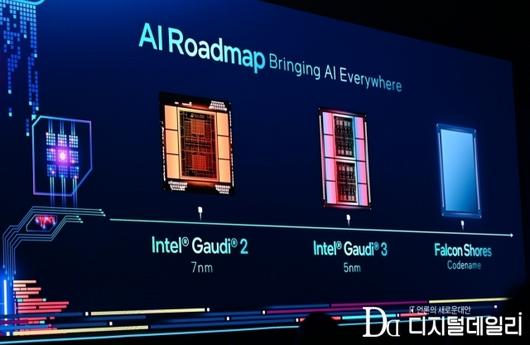

인텔은 7나노 기반 인텔 ‘가우디2’에 이어 보다 미세공정을 도입한 5나노 기반 인텔 가우디3로 나아간다. 가우디3는 전세대 대비 BF16 4배, 컴퓨트 2배, 네트워크 대역폭 1.5배, HBM 캐퍼시티 1.5배 더 높은 성능을 갖추고 있다. 이어 코드명 ‘팔콘 쇼어’가 기다리고 있다.

겔싱어 CEO는 “오는 2025년 팔콘 쇼어 제품이 뒤 따를 것”이라며, “우리의 로드맵을 매우 강력하며 이를 통합하기 위해 적극적으로 실행에 나서고 있다. 물론 그 실행은 무어의 법칙에 기초한다”고 설명했다.

인텔의 차세대 맥스 시리즈인 팔콘 쇼어는 미래의 새로운 워크로드를 위해 시스템 수준의 CPU와 외장 GPU를 유연하게 조합할 수 있도록 지원할 예정이다. FP64에서 BF16, FP8에 이르는 HPC 및 AI 데이터 유형 지원, 최대 9.8TB/s의 총 대역폭과 대폭 향상된 고속 I/O로 최대 288GB의 HBM3 메모리 사용 가능, CXL 프로그래밍 모델 강화, 원API를 통해 통합된 GPU 프로그래밍 인터페이스를 제공할 것으로 기대된다.

- Copyright ⓒ 디지털데일리. 무단전재 및 재배포 금지 -

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.