|

연결되지 않은 콘텐츠를 검색하고 순위를 매기는 온라인 시스템 (사진=링크드인) |

13억명이 사용하는 글로벌 비즈니스 플랫폼 링크드인이 기존 추천 시스템을 전면 재설계하고, 대형언어모델(LLM)을 중심으로 한 차세대 피드 아키텍처를 도입했다. 단순한 알고리즘 개선을 넘어, 콘텐츠 추천 방식과 인프라 구조를 근본적으로 바꾼 대규모 전환이다.

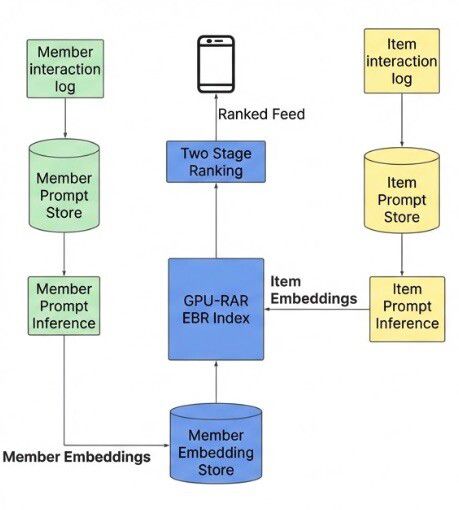

링크드인은 12일(현지시간) 그동안 서로 다른 목적을 가진 5개의 콘텐츠 검색(retrieval) 파이프라인을 운영해 왔지만, 이를 하나의 LLM 기반 시스템으로 통합했다고 밝혔다.

이번 개편을 통해 사용자의 직무, 관심사, 행동 패턴을 더 정밀하게 이해하면서도 운영 비용을 낮출 수 있게 됐다고 설명했다.

기존 피드는 네트워크 기반 게시물, 지역 트렌드, 관심사 필터링, 산업별 콘텐츠 등 다양한 소스에서 데이터를 가져오는 복잡한 구조였다. 각 시스템은 서로 다른 인프라와 최적화 방식으로 운영, 유지 비용이 크게 증가하는 문제가 있었다.

링크드인은 이를 해결하기 위해 LLM 임베딩 기반의 통합 검색 시스템을 구축했다. 이 시스템은 단순 키워드 매칭을 넘어, 사용자의 직무와 관심사를 맥락적으로 이해해 보다 정교한 콘텐츠 추천을 가능하게 한다.

'전기공학'에 관심이 있는 사용자가 '소형 모듈 원자로' 관련 콘텐츠를 자주 소비할 경우, 기존 시스템은 이를 연결하지 못했다. 그러나 LLM 기반 모델은 두 주제 간 의미적 연관성을 파악해 관련 콘텐츠를 추천할 수 있다.

추천 방식도 크게 바뀌었다. 자체 개발한 생성 추천 모델(GR·Generative Recommender)을 도입해, 사용자의 행동을 단순한 클릭 데이터가 아닌 시간 흐름을 가진 '전문적 여정'으로 해석한다.

이 모델은 수천개의 과거 상호작용을 차례로 분석해, 사용자의 장기적인 관심 변화와 패턴을 파악한다. 특정 기술 주제에 대한 관심이 점진적으로 확대되는 경우, 이를 반영해 더 깊이 있는 콘텐츠를 추천하는 식이다.

LLM 적용 과정에서 링크드인은 중요한 기술적 문제도 발견했다. 조회수나 '좋아요' 같은 숫자 정보가 단순 텍스트로 처리되면서, 의미가 제대로 반영되지 않는 문제가 발생한 것이다.

이를 해결하기 위해 숫자를 백분위 구간으로 변환하고 특수 토큰으로 감싸는 방식을 도입했다. 이 방법은 모델이 콘텐츠 인기도를 더 정확히 이해하도록 도와, 추천 품질을 크게 개선하는 데 기여했다는 설명이다.

대규모 LLM 시스템 도입에 따른 비용 문제도 해결 과제였다. 링크드인은 CPU와 GPU 작업을 분리하는 구조를 도입하고, 데이터 로딩과 어텐션 연산을 최적화하는 맞춤형 기술을 개발했다.

이를 통해 수천개 게시물을 실시간으로 분석하면서도 지연 시간은 낮추고, GPU 사용 효율은 높이는 데 성공했다. 실제로 수백만 개 콘텐츠 중에서 개인화된 후보를 수십 밀리초 내에 추출할 수 있는 수준에 도달한 것으로 알려졌다.

박찬 기자 cpark@aitimes.com

<저작권자 Copyright ⓒ AI타임스 무단전재 및 재배포 금지>

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.