|

(사진=셔터스톡) |

<이미지를 클릭하시면 크게 보실 수 있습니다> |

중국 정부가 사상 검열을 위해 인터넷에서 민감한 콘텐츠를 자동으로 식별하는 대형언어모델(LLM)을 개발한 정황이 포착됐다.

테크크런치는 27일(현지시간) 유출된 데이터베이스를 분석, 중국 정부가 온라인 검열을 목적으로 인공지능(AI) 모델 훈련에 활용한 데이터의 내용을 공개했다.

이 데이터베이스에는 '중국 농촌 지역의 빈곤'이나 '부패한 공산당 당원에 대한 뉴스 보도' '기업가를 괴롭히는 부패 경찰에 대한 도움 요청' 등 13만3000개의 사례가 포함돼 있다. 이는 이미 알려진 천안문 사태나 시진핑 국가 주석과 같은 전통적인 금기 주제를 넘어서는 것이다.

이 데이터는 넷아스카리(NetAsari)라는 보안 전문가가 바이두 서버에 호스팅된 일래스틱서치(Elasticsearch) 데이터베이스에서 발견한 것이다.

데이터셋의 제작자는 확인되지 않았으나, 다양한 조직이 일래스틱서치에 데이터를 저장해왔던 것으로 추정했다.

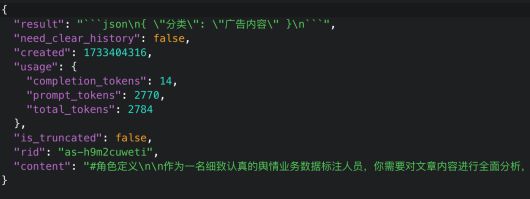

데이터셋은 크기가 약 300기가바이트(GB)에 달하며 JSON 파일로 구성됐다. 여기에는 2024년 12월까지의 정보가 포함됐다.

|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

이 데이터셋으로 훈련된 LLM은 정치와 사회, 군사 등 민감한 주제의 키워드를 발견하면, 이를 '최우선 순위'로 표시한다. 주요 감시 대상에는 종종 중국에서 시위로 이어지는 오염 문제나 식품 안전사고, 금융 사기, 노동 분쟁 등이 포함됐다.

특히 '정치 풍자'는 엄격한 검열 대상로, 현 정치인을 우회적으로 비판하는 경우에도 즉시 경고가 발동한다. 대만 정치 관련 내용도 예외 없이 검열된다. 군사 이동, 훈련, 무기 관련 보고서 등 군사 관련 정보도 마찬가지다.

이 데이터셋에는 "여론 작업을 목적으로 한다"라고 명시돼 있으며, 이는 중국 정부를 지원하는 것으로 보인다는 분석이다.

실제로 시진핑 주석은 인터넷을 공산당의 '여론 작업'의 최전선이라고 언급한 바 있다. 여론 작업은 중국 사이버공간 관리국(CAC) 소관으로, 이 기관은 중국 내 인터넷과 AI 서비스를 총괄 감독하고 있다.

중국 검열 전문인 샤오 창 UC 버클리 연구원은 데이터셋에 대해 "중국 정부 또는 관계 기관이 LLM을 억압 강화를 위한 도구로 활용하려 한다는 명확한 증거"라고 말했다.

또 "기존 검열 방식은 키워드 필터링과 수작업 검토에 의존하지만, LLM을 사용하면 정보 통제의 효율성과 정확도가 크게 향상될 것"이라고 강조했다.

오픈AI도 지난 2월 여러 중국 기관이 LLM을 사용해 반정부 게시물을 감시하고 반체제 인사를 비방한 사례를 적발한다고 밝힌 바 있다.

이에 대해 중국 대사관은 "중국을 향한 근거 없는 공격과 비방에 반대한다"라며 "중국은 윤리적인 AI 개발을 매우 중요하게 여긴다"라고 반박했다.

박찬 기자 cpark@aitimes.com

<저작권자 Copyright ⓒ AI타임스 무단전재 및 재배포 금지>

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.