|

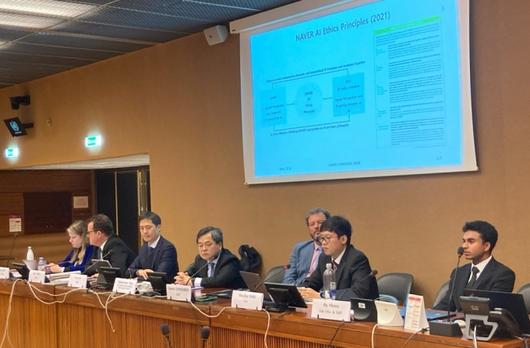

네이버 정책/RM 아젠다 박우철 변호사(오른쪽에서 두 번째)가 네이버 AI 안전 정책 사례를 발표하고 있다./사진제공=네이버 |

<이미지를 클릭하시면 크게 보실 수 있습니다> |

네이버(NAVER)가 5일 스위스의 UN 제네바 사무소에서 개최된 '신기술에 대한 인권 기반의 접근: 컨셉에서 구체적 적용으로(Towards a human rights-based approach to new and emerging technologies: From concept to implementation)' 행사에 참석해 안전한 AI(인공지능) 생태계 구축을 위한 노력을 소개했다고 6일 밝혔다.

서울대 인공지능 정책 이니셔티브(SAPI) 및 Universal Rights Group(URG)이 주제네바 대한민국 대표부와 공동으로 주최한 이번 행사에서 SAPI 연구진은 '인권 중심의 규범을 업무 현장에 적용하는 현실적인 지침'을 다룬 올해 보고서를 발표했다. 주제네바 대한민국 대표부 윤성덕 대사, 서울대 임용 교수와 스테판 손넨버그 교수 그리고 UN 인권최고대표사무소 관계자 등은 AI를 비롯한 새로운 디지털 기술을 인권 바탕으로 발전시키기 위한 다양한 방안을 논의했다.

네이버는 안전한 AI를 위한 추상적 원칙을 산업 실무에 적용해온 사례들을 공유했다. 발표를 맡은 네이버 정책/RM 아젠다 박우철 변호사는 2022년부터 운영 중인 네이버 AI 윤리 자문 프로세스 'CHEC(Consultation on Human-centered AI's Ethical Considerations)'를 소개했다. CHEC는 '네이버 AI 윤리 준칙'을 실제 서비스 출시 과정에 적용하기 위해 설계한 정책으로 일방적 점검이 아닌 기획 및 개발 단계에서부터 사회적 관점을 함께 고려하는 상호작용 과정이라는 특징이 있다.

네이버 AI 윤리 준칙을 구체화하기 위한 다른 정책들에 대한 소개도 이어졌다. 2023년에 공개한 '사람을 위한 클로바X 활용 가이드'는 빠르게 발전하는 생성형 AI 기술에 네이버 AI 윤리 준칙이 어떻게 적용될 수 있을지에 대해 고민한 결과물이다. 네이버는 올해 AI 시스템을 개발하고 배포하는 과정에서 AI의 잠재적 위험을 더욱 체계적으로 인식·평가·관리하기 위해 네이버 ASF(AI Safety Framework)도 새롭게 구축했다.

네이버는 다양한 글로벌 커뮤니티와 협업하며 AI 안전성 분야 리더십을 갖춰나가고 있다. 올해 UN의 AI 안전성 보고서 작성에 기술 자문을 제공했으며 다수 빅테크가 참여하는 개방형 컨소시엄 'MLCommons'에서 AI 안전 벤치마크 구축 작업에 기여했다. 지난 7월에는 AI 워터마크 기술 표준을 구축한 'C2PA(Coalition for Content Provenance and Authenticity)'에 국내 최초로 가입하기도 했다.

하정우 네이버 퓨처 AI 센터장은 "네이버는 AI 기술의 빠른 변화 속에서 주요 AI 기술을 내재화하면서 서비스 기획·개발 현장과의 긴밀한 소통을 바탕으로 구체적이고 현실적인 안전 정책을 수립함으로써 AI 안전성 분야에서도 글로벌 리더 그룹으로 인정받고 있다"라며 "앞으로도 우수한 AI 기술력을 확보하는 한편 안전하고 지속할 수 있는 글로벌 AI 생태계를 만드는 데에도 앞장설 것"이라고 말했다.

이정현 기자 goronie@mt.co.kr

ⓒ 머니투데이 & mt.co.kr, 무단 전재 및 재배포 금지

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.